摘 要:2025年1月,清华大学发布法律大模型LegalOne-R1,参数版本覆盖1.7B至8B,基于华为昇腾平台实现全流程国产化训练。LexisNexis 2025年调研显示,88%的中国内地律师已在工作中应用生成式AI工具,较2024年提升20个百分点[1]。与此同时,美国Mata v. Avianca案中,律师因提交ChatGPT虚构案例被处5,000美元罚款[2]。技术红利与执业风险并存。本文从数据输入风险、内容复核义务、执业责任边界、行业规范动态四个维度,为律师与企业法务梳理AI使用的合规框架与风控路径。本文分上下篇刊出。

四、 执业责任边界:过错认定与风险分配

(一)企业常问的痛点问题

“如果AI给出的法律策略是错的,导致我败诉,能要求律师赔偿吗?”

(二)法理拆解

1. 律师的勤勉尽责义务

《律师法》第54条规定:“律师违法执业或者因过错给当事人造成损失的,由其所在的律师事务所承担赔偿责任。”

核心问题:使用AI辅助办案,是否属于“过错”?

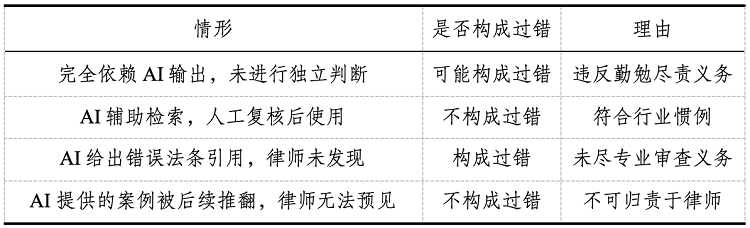

目前司法实践中尚无明确判例,但从法理分析,可能存在以下认定标准:

2. 责任分担机制的合同安排

部分律所开始在委托合同中加入AI使用条款:

“本所将使用人工智能工具辅助法律检索、文书起草等工作。所有AI生成内容均经主办律师复核后方可对外提交。委托人知悉并同意上述工作方式。”

这类条款的效力尚未经过司法检验,但至少可以证明:律所已履行告知义务,未隐瞒AI使用情况。

(三)律师应对策略

我们团队采取三项风险对冲措施:

1. 建立AI使用留痕制度

每次使用AI辅助办案,留存以下记录:使用场景、输入内容摘要(脱敏版本)、AI输出内容、人工复核意见、最终决策依据。

这些记录在发生争议时,可以证明律师进行了独立判断,而非盲目依赖AI。

2. 在委托合同中明确告知

我们团队在《委托代理合同》中增加专门条款:

“本所律师将使用经合规审查的人工智能工具辅助法律服务工作。所有AI生成内容均由主办律师复核确认。如您对AI使用有特殊要求,请提前书面告知。”

五、 行业规范动态:监管正在逼近

(一)现状梳理

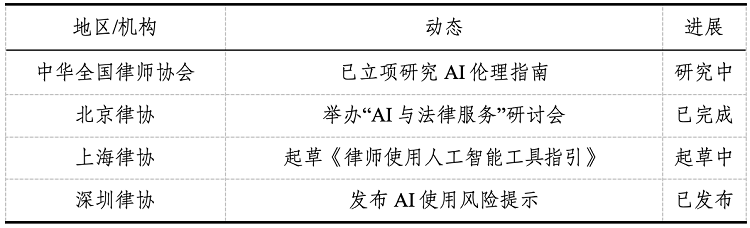

截至目前,全国律协及各省律协尚未出台专门针对AI使用的执业规范。但监管动向已经显现:

可以预见:未来1-2年内,AI使用规范将成为律师执业合规的必选项。

(二)前瞻布局建议

不等监管落地,建议律师团队先行建立内部AI合规体系:

1. AI工具准入制度

不是所有AI工具都可以使用。建议建立准入评估标准:数据存储位置(境内/境外)、数据留存期限、是否用于模型训练、是否通过安全认证。

2. 定期合规审查机制

每季度对AI使用情况进行内部审查:使用频次与场景、是否发生数据泄露事件、是否出现AI输出质量问题、监管政策变化。

六、 志愿填报注意事项

1. 建立数据分级制度,红线数据绝不触碰

红灯数据(商业秘密、财务底稿、涉案证据)禁止输入任何AI;黄灯数据(案件框架、法律关系)脱敏后可使用私有化AI;绿灯数据(法规、公开案例)可使用公有云AI。

2. AI输出必须人工复核,签名即担责

律师签名意味着对内容的完全责任。AI生成的是草稿,不是成品。复核重点:法条准确性、案例真实性、逻辑完整性。

3. 保留AI使用记录,以备合规审查

记录使用场景、输入摘要、输出内容、复核意见。发生争议时,证明律师进行了独立判断。

4. 在委托合同中告知AI使用情况

明确告知客户AI辅助办案的流程与范围,给客户选择权。

5. 关注监管动态,提前布局合规体系

跟踪各地律协AI使用指南,建立内部AI合规制度。

七、 结 语

AI正在重塑法律行业。对于律师与企业法务而言,关键在于:在拥抱技术红利的同时,守住职业操守的底线。数据输入风险、内容复核义务、执业责任边界——这三个环节构成AI合规的全链条。任何一个环节失守,都可能葬送职业生涯。Mata v. Avianca案已经给出警示:技术进步不会降低职业责任标准。通过建立科学的AI合规框架,律师完全可以既享受AI的效率红利,又守住执业安全底线。未来已来。与其恐惧,不如主动拥抱,并在拥抱中保持清醒。

参考文献

[1] LexisNexis. Lexis+ AI™ China 正式上线:为中国法律人打造真正的专业AI助手[EB/OL]. 2025. https://www.lexisnexis.com/blogs/cn/b/events-news/posts/lexis-ai-china-launch

[2] Mata v. Avianca, Inc., No. 22-cv-1461 (S.D.N.Y. June 22, 2023). 美国纽约南区联邦地方法院,法官Kevin Castel对原告律师处以5,000美元罚款。

[3] 国家互联网信息办公室等七部门. 生成式人工智能服务管理暂行办法[Z]. 2023年8月15日施行. 第7条.